источник

Вашему вниманию предлагается статья о том, как был создан онлайн курс по тематике «Функциональная безопасность». Сервисы онлайн обучения располагают студийным оборудованием для записи высококачественного звука и видео. А если вдруг представить, что доступа у вас к подобным ресурсам нет, а учебный материал надо подготовить для использования в онлайн режиме? Автор решил поделиться собственным опытом и раскрыть следующие вопросы:

- мотивация или зачем и кому это надо;

- инструменты подготовки и записи;

- содержание Massive Online Open Course (MOOC) по функциональной безопасности;

- дальнейшие шаги по развитию продукта.

Мотивация: зачем это делалось?

Будучи вовлеченным в образовательный процесс, пришлось решать задачу дистанционного обучения студентов направления «Кибербезопасность» на кафедре компьютерных систем и сетей Национального аэрокосмического университета «Харьковский авиационный институт». Дистанционность эта образовалась по причине моей географической удаленности.

Были и другие мотиваторы. Хотелось попробовать силы в новой для меня технологии преподавания, и посмотреть, как это работает.

Еще была задача подготовить консалтинговые материалы для коллег из индустрии, с которыми приходится обсуждать вопросы сертификации. Порог входа «с нуля» в эту тематику порой оказывается достаточно высоким, а, просмотрев материалы, можно приобрести достаточный уровень знаний, чтобы начать работать в проекте по сертификации. Поэтому, изначально ставилась цель сделать курс проблемно-ориентированным, то есть направленным на решение практической задачи: подготовка к сертификации на соответствие требованиям МЭК 61508 (либо других подобных стандартов по функциональной безопасности).

Таким образом, слушатели курса получили весь набор преимуществ пользователей MOOC: слушаем небольшими информационными блоками, изучаем в удобное время, если что-то не поняли или пропустили, то «прокручиваем» повторно и т.п. Очень подходит для студентов старших курсов, которые уже хотят решить вопрос с трудоустройством, и объясняют этим пропуск занятий.

В предметной области ориентир был сделан, в первую очередь, на АСУ ТП, но затрагивались и другие архитектуры систем управления: встроенные системы, интернет вещей и промышленный интернет вещей (Industrial IoT or Industrial Internet Control Systems).

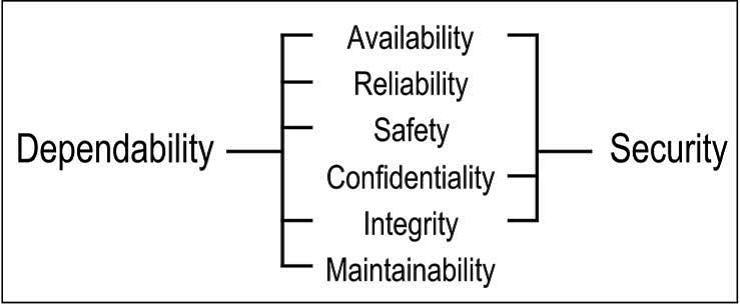

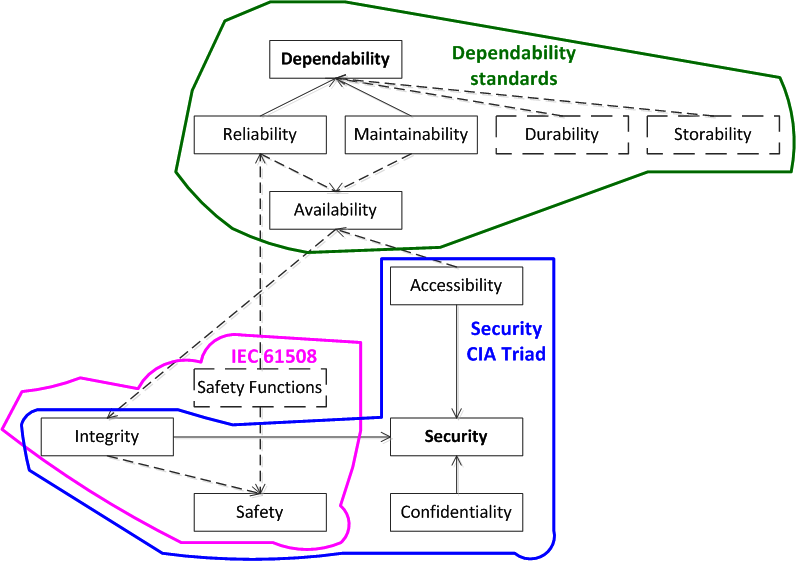

Взгляд на обеспечение безопасности был направлен с точки зрения функциональной составляющей. Однако, там где это было уместно, демонстрировалась связь между и информационной безопасностью (ИБ) и функциональной безопасностью (ФБ). Например, рассматривался единый жизненный цикл ИБ и ФБ. Рассматривалось, какие методы обеспечения ФБ одновременно повышают уровень ИБ. В обратной связи студенты отметили, что как раз такой фокус был для них полезен.

Еще одна особенность видеолекций состояла в том, что слайды представлены на английском, а аудио записано на русском языке. Предполагаю, что части аудитории может не понравиться подобный «тяни-толкай», но все же попытаюсь объяснить, что с переводом специфической терминологии на русский язык не все обстоит гладко. Смотрим, например, терминологию из МЭК 61508, часть 4. Validation (3.8.2) переводится как «подтверждение соответствия», и это не единственный пример.

Подготовка и запись курса

В ходе подготовительных мероприятий был прослушан онлайн курс на тему «MOOC про MOOC», благо, подобные материалы сейчас доступны во множестве. Многое из услышанного оказалось крайне полезным и подтвердило тезис о действенности онлайн обучения.

Затем был проведен обзор доступных (на начало 2017 года) ресурсов в сети, которые бы частично или полностью соответствовали тому, что планировалось сделать. Оказалось, что курсов в формате MOOC, посвященных ФБ, не существует, хотя по ИБ, например, их множество. Однако, студентам похожие дисциплины читают. Наиболее похожим оказался курс MIT System Safety (преподает профессор Nancy Leveson). Однако, на сайте MIT доступны лишь учебные материалы, поэтому этот курс не являет MOOC в полном смысле слова. Еще один идеологически близкий курс, Software Security Engineering, был обнаружен в программе Software Engineering Institute (SEI), преподает его Nancy Mead. Таким образом, гипотеза об уникальности записываемого материала была подтверждена, то есть, ниша для MOOC по функциональной безопасности оказалась свободна.

И, наконец, был заполнен шаблон описания MOOC, близкий к привычным учебным программам. Одно из отличий, делающих MOOC крайне затратным занятием, – это необходимость предварительного написания полного текста лекции, сопровождающего видеоряд слайдов. Похоже, что владение материалом и разговорной речью здесь не очень помогает. Импровизации и паузы, которые вполне уместны при выступлении в аудитории, совершенно не вяжутся с лаконичным форматом MOOC.

Как это все записывалось? Мое пребывание на «необитаемом острове» с ограниченным доступом к ресурсам привело к тому, что все организовывалосьсамым эффективным самым простым образом. Конфигурация имеющегося лэптопа не предусматривала входа для микрофона, поэтому запись звука производилась с помощью встроенного микрофона. Конечно, это не очень хорошо, но, возможно, уникальность и качество материала смогут примирить с этим багом этой фичей.

Вводный ролик был записан на видеокамеру в формате HD. Все остальные материалы записывались с демонстрацией слайдов и голосом за кадром, без появления лектора на экране.

Для захвата видео и звука использовалась программа oCam. Никаких хлопот с ее установкой и применением не возникало. Видео записывалось в формате ISO MPEG-4 в целях последующей обработки видеоредактором YouTube. Как оказалось, видеоредактор YouTube еще и несколько улучшает качество нестудийного звука.

Содержание MOOC «Функциональная безопасность компьютерных систем»

Курс включает шесть лекций или, в терминологии MOOC, шесть недель обучения.

Лекции выложены на канале YouTube в виде следующих плейлистов (содержание плейлистов-лекций показано на рисунке 1):

Лекция 1. Введение в функциональную безопасность

Лекция 2. Требования стандарта МЭК 61508

Лекция 3. Управление функциональной безопасностью

Лекция 4. Жизненный цикл функциональной и информационной безопасности

Лекция 5. Оценивание показателей функциональной безопасности

Лекция 6. Методы обеспечения функциональной безопасности

Рисунок 1. Структура MOOC «Функциональная безопасность компьютерных систем»

Самостоятельная работа студентов реализуется по четырем направлениям:

- ответ на контрольные вопросы (quiz);

- чтение рекомендованной литературы;

- при желании – изучение дополнительных материалов, превышающих объем программы;

- и, самое главное, – индивидуальный проект.

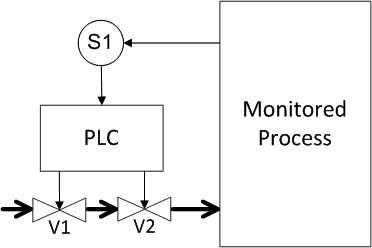

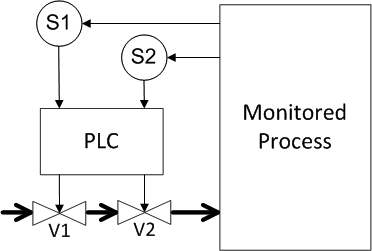

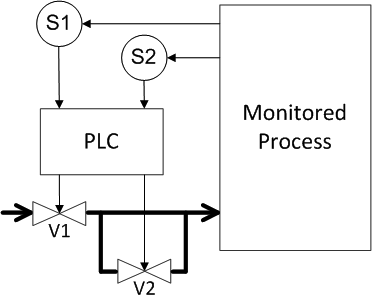

Индивидуальный проект является главным результатом изучения курса, где важно не только найти заранее известные ответы на контрольные вопросы, а, прежде всего, необходимо решить прикладную задачу, основанную на получаемых знаниях. Такой задачей является разработка собственного документа, охватывающего оценивание ФБ по направлениям, изучаемым в лекционном материале. Называется этот документ Assurance Case (или «обоснование безопасности» в смысловом, а не в прямом переводе). Разработка Assurance Case применяется в практике оценивания и сертификации ИБ (Security Case) и ФБ (Safety Case). В качестве объектов оценивания предлагаются компоненты АСУ ТП: контроллеры, исполнительные механизмы и датчики. Студентам выдается шаблон Assurance Case, и они его поэтапно заполняют, основываясь на материале каждой из лекции. Структура шаблона показана на Рисунке 2.

Рисунок 2. Структура индивидуального задания (Assurance Case), выполняемого в ходе изучения MOOC «Функциональная безопасность компьютерных систем»

Выводы

Запись MOOC является увлекательным занятием, которое требует серьезных временных инвестиций. У каждого своя скорость проговаривания текста и его написания. Мои оценки говорят о том, что тысячу знаков текста (это полстраницы формата А4 с 14-м шрифтом через полуторный интервал) можно озвучить приблизительно за одну минуту. То есть, например, для подготовки записи получасовой лекции надо написать приблизительно 30 тысяч знаков (15 страниц текста).

Но, зато, этот текст легко скомпоновать в статью. Именно так и появился цикл статей по функциональной безопасности, он разрабатывался параллельно с онлайн курсом.

Судя по обратной связи от студентов, этот формат они восприняли позитивно. Многие статистические исследования в области по MOOC говорят, что на успешность усвоения материала влияет не онлайн / офлайн форма, а, в первую очередь, мотивация студентов. Те, кто хотел, прекрасно справились с индивидуальным заданием.

Работая над курсом, я почувствовал, насколько все-таки медленно возможности технологий осваиваются некоторыми вузами. А реалии таковы, что мало кому удается повлиять на этот процесс. Как говаривал Вильям Гибсон, “the future is already here – it’s just not very evenly distributed”.

Разумеется, что предлагаемый набор плейлистов YouTube пока не может считаться полномасштабным MOOC, и после пилотной версии продукта необходимо выполнить еще ряд действий по доводке, а именно:

- добавить анимационные заставки;

- перенести курс в среду разработки MOOC (рассматривается edX);

- разработать онлайн тесты;

- разместить курс на одной или нескольких платформах онлайн обучения;

- набрать и обучить группу;

- а также, в перспективе, записать англоязычный вариант курса.

Этим и займемся в ближайшее время.

Вашему вниманию предлагается статья о том, как был создан онлайн курс по тематике «Функциональная безопасность». Сервисы онлайн обучения располагают студийным оборудованием для записи высококачественного звука и видео. А если вдруг представить, что доступа у вас к подобным ресурсам нет, а учебный материал надо подготовить для использования в онлайн режиме? Автор решил поделиться собственным опытом и раскрыть следующие вопросы:

- мотивация или зачем и кому это надо;

- инструменты подготовки и записи;

- содержание Massive Online Open Course (MOOC) по функциональной безопасности;

- дальнейшие шаги по развитию продукта.

Мотивация: зачем это делалось?

Будучи вовлеченным в образовательный процесс, пришлось решать задачу дистанционного обучения студентов направления «Кибербезопасность» на кафедре компьютерных систем и сетей Национального аэрокосмического университета «Харьковский авиационный институт». Дистанционность эта образовалась по причине моей географической удаленности.

Были и другие мотиваторы. Хотелось попробовать силы в новой для меня технологии преподавания, и посмотреть, как это работает.

Еще была задача подготовить консалтинговые материалы для коллег из индустрии, с которыми приходится обсуждать вопросы сертификации. Порог входа «с нуля» в эту тематику порой оказывается достаточно высоким, а, просмотрев материалы, можно приобрести достаточный уровень знаний, чтобы начать работать в проекте по сертификации. Поэтому, изначально ставилась цель сделать курс проблемно-ориентированным, то есть направленным на решение практической задачи: подготовка к сертификации на соответствие требованиям МЭК 61508 (либо других подобных стандартов по функциональной безопасности).

Таким образом, слушатели курса получили весь набор преимуществ пользователей MOOC: слушаем небольшими информационными блоками, изучаем в удобное время, если что-то не поняли или пропустили, то «прокручиваем» повторно и т.п. Очень подходит для студентов старших курсов, которые уже хотят решить вопрос с трудоустройством, и объясняют этим пропуск занятий.

В предметной области ориентир был сделан, в первую очередь, на АСУ ТП, но затрагивались и другие архитектуры систем управления: встроенные системы, интернет вещей и промышленный интернет вещей (Industrial IoT or Industrial Internet Control Systems).

Взгляд на обеспечение безопасности был направлен с точки зрения функциональной составляющей. Однако, там где это было уместно, демонстрировалась связь между и информационной безопасностью (ИБ) и функциональной безопасностью (ФБ). Например, рассматривался единый жизненный цикл ИБ и ФБ. Рассматривалось, какие методы обеспечения ФБ одновременно повышают уровень ИБ. В обратной связи студенты отметили, что как раз такой фокус был для них полезен.

Еще одна особенность видеолекций состояла в том, что слайды представлены на английском, а аудио записано на русском языке. Предполагаю, что части аудитории может не понравиться подобный «тяни-толкай», но все же попытаюсь объяснить, что с переводом специфической терминологии на русский язык не все обстоит гладко. Смотрим, например, терминологию из МЭК 61508, часть 4. Validation (3.8.2) переводится как «подтверждение соответствия», и это не единственный пример.

Подготовка и запись курса

В ходе подготовительных мероприятий был прослушан онлайн курс на тему «MOOC про MOOC», благо, подобные материалы сейчас доступны во множестве. Многое из услышанного оказалось крайне полезным и подтвердило тезис о действенности онлайн обучения.

Затем был проведен обзор доступных (на начало 2017 года) ресурсов в сети, которые бы частично или полностью соответствовали тому, что планировалось сделать. Оказалось, что курсов в формате MOOC, посвященных ФБ, не существует, хотя по ИБ, например, их множество. Однако, студентам похожие дисциплины читают. Наиболее похожим оказался курс MIT System Safety (преподает профессор Nancy Leveson). Однако, на сайте MIT доступны лишь учебные материалы, поэтому этот курс не являет MOOC в полном смысле слова. Еще один идеологически близкий курс, Software Security Engineering, был обнаружен в программе Software Engineering Institute (SEI), преподает его Nancy Mead. Таким образом, гипотеза об уникальности записываемого материала была подтверждена, то есть, ниша для MOOC по функциональной безопасности оказалась свободна.

И, наконец, был заполнен шаблон описания MOOC, близкий к привычным учебным программам. Одно из отличий, делающих MOOC крайне затратным занятием, – это необходимость предварительного написания полного текста лекции, сопровождающего видеоряд слайдов. Похоже, что владение материалом и разговорной речью здесь не очень помогает. Импровизации и паузы, которые вполне уместны при выступлении в аудитории, совершенно не вяжутся с лаконичным форматом MOOC.

Как это все записывалось? Мое пребывание на «необитаемом острове» с ограниченным доступом к ресурсам привело к тому, что все организовывалось

Вводный ролик был записан на видеокамеру в формате HD. Все остальные материалы записывались с демонстрацией слайдов и голосом за кадром, без появления лектора на экране.

Для захвата видео и звука использовалась программа oCam. Никаких хлопот с ее установкой и применением не возникало. Видео записывалось в формате ISO MPEG-4 в целях последующей обработки видеоредактором YouTube. Как оказалось, видеоредактор YouTube еще и несколько улучшает качество нестудийного звука.

Содержание MOOC «Функциональная безопасность компьютерных систем»

Курс включает шесть лекций или, в терминологии MOOC, шесть недель обучения.

Лекции выложены на канале YouTube в виде следующих плейлистов (содержание плейлистов-лекций показано на рисунке 1):

Лекция 1. Введение в функциональную безопасность

Лекция 2. Требования стандарта МЭК 61508

Лекция 3. Управление функциональной безопасностью

Лекция 4. Жизненный цикл функциональной и информационной безопасности

Лекция 5. Оценивание показателей функциональной безопасности

Лекция 6. Методы обеспечения функциональной безопасности

Рисунок 1. Структура MOOC «Функциональная безопасность компьютерных систем»

Самостоятельная работа студентов реализуется по четырем направлениям:

- ответ на контрольные вопросы (quiz);

- чтение рекомендованной литературы;

- при желании – изучение дополнительных материалов, превышающих объем программы;

- и, самое главное, – индивидуальный проект.

Индивидуальный проект является главным результатом изучения курса, где важно не только найти заранее известные ответы на контрольные вопросы, а, прежде всего, необходимо решить прикладную задачу, основанную на получаемых знаниях. Такой задачей является разработка собственного документа, охватывающего оценивание ФБ по направлениям, изучаемым в лекционном материале. Называется этот документ Assurance Case (или «обоснование безопасности» в смысловом, а не в прямом переводе). Разработка Assurance Case применяется в практике оценивания и сертификации ИБ (Security Case) и ФБ (Safety Case). В качестве объектов оценивания предлагаются компоненты АСУ ТП: контроллеры, исполнительные механизмы и датчики. Студентам выдается шаблон Assurance Case, и они его поэтапно заполняют, основываясь на материале каждой из лекции. Структура шаблона показана на Рисунке 2.

Рисунок 2. Структура индивидуального задания (Assurance Case), выполняемого в ходе изучения MOOC «Функциональная безопасность компьютерных систем»

Выводы

Запись MOOC является увлекательным занятием, которое требует серьезных временных инвестиций. У каждого своя скорость проговаривания текста и его написания. Мои оценки говорят о том, что тысячу знаков текста (это полстраницы формата А4 с 14-м шрифтом через полуторный интервал) можно озвучить приблизительно за одну минуту. То есть, например, для подготовки записи получасовой лекции надо написать приблизительно 30 тысяч знаков (15 страниц текста).

Но, зато, этот текст легко скомпоновать в статью. Именно так и появился цикл статей по функциональной безопасности, он разрабатывался параллельно с онлайн курсом.

Судя по обратной связи от студентов, этот формат они восприняли позитивно. Многие статистические исследования в области по MOOC говорят, что на успешность усвоения материала влияет не онлайн / офлайн форма, а, в первую очередь, мотивация студентов. Те, кто хотел, прекрасно справились с индивидуальным заданием.

Работая над курсом, я почувствовал, насколько все-таки медленно возможности технологий осваиваются некоторыми вузами. А реалии таковы, что мало кому удается повлиять на этот процесс. Как говаривал Вильям Гибсон, “the future is already here – it’s just not very evenly distributed”.

Разумеется, что предлагаемый набор плейлистов YouTube пока не может считаться полномасштабным MOOC, и после пилотной версии продукта необходимо выполнить еще ряд действий по доводке, а именно:

- добавить анимационные заставки;

- перенести курс в среду разработки MOOC (рассматривается edX);

- разработать онлайн тесты;

- разместить курс на одной или нескольких платформах онлайн обучения;

- набрать и обучить группу;

- а также, в перспективе, записать англоязычный вариант курса.

Этим и займемся в ближайшее время.